- Apotheken-Notdienst

- Podcast

-

Podcast: "gecheckt!"

- Podcasts: Allergien

- Podcasts: Apotheke

- Podcasts: Arzneimittel

- Podcasts: Baby und Familie

- Podcasts: Diabetes

- Podcasts: Erkältung

- Podcasts: Ernährung

- Podcasts: Frauengesundheit

- Podcasts: Gesund leben

- Podcasts: Haut & Haare

- Podcasts: Magen-Darm

- Podcasts: Männergesundheit

- Podcasts: Medizin

- Podcasts: Naturheilkunde

- Podcasts: Psychologie

- Podcasts: Sport & Bewegung

- Podcasts: Zähne

- Podcast: Was ist das überhaupt?

- Newsletter

- Apotheke

- Medizin

- Naturheilkunde

- Ernährung

- Sport & Wellness

- Jung & Alt

- Frau & Mann

- Gesellschaft

- Service

- Gewinnspiel

- Das Apotheken Magazin

- Autoren

ChatGPT Health: Ernste Schwächen bei Suizidgedanken und Notfällen

Eine erste, unabhängige Begutachtung zeigt Sicherheitsprobleme bei ChatGPT Health. Besonders bei Notfällen und Suizidgedanken reagierte das System nicht immer zuverlässig.

© shurkin_son/iStockphoto

ChatGPT Health ist eine spezielle Funktion im Sprachmodell ChatGPT, die selbstständig Gesundheitsdaten auswertet. Die Anwendung ist in den USA schon verfügbar und berät Patienten. Sie gibt z. B. einen Hinweis, wenn dringend eine Arztpraxis oder Klinik aufgesucht werden sollte. Forschende haben bei einer unabhängigen Überprüfung festgestellt, dass dies nicht einwandfrei funktioniert und dass ChatGPT Health insbesondere Suizidabsichten nicht gut erkennt.

Suizidgedanken: Zuverlässige Warnmeldungen bei geringem Risiko – weniger bei hohem

ChatGPT Health ordnete Menschen mit Suizidgedanken nicht korrekt ein – was lebensgefährliche Folgen haben kann. „Wir hatten zwar mit gewissen Schwankungen gerechnet, aber unsere Beobachtungen gingen weit über bloße Inkonsistenzen hinaus. Die Warnmeldungen des Systems verhielten sich umgekehrt proportional zum klinischen Risiko: Sie erschienen zuverlässiger bei Szenarien mit geringerem Risiko als in Fällen, in denen jemand seine Absicht zur Selbstverletzung schilderte. In der Realität ist es ein Zeichen für eine unmittelbare und ernste Gefahr, wenn jemand detailliert beschreibt, wie er sich selbst verletzen würde. Dies war ein besonders überraschendes und besorgniserregendes Ergebnis“, sagte Dr. Girish N. Nadkarni vom Mount Sinai Health System in einer Mitteilung zur Studie.

Notfall-Patienten beruhigt, harmlose Fälle zum Notruf weitergeleitet

Bei der Überprüfung von 60 realistischen Patientenszenarien leitete ChatGPT Health eindeutige Notfälle meist korrekt weiter. Doch in mehr als der Hälfte der Fälle, die laut Ärzten eine notfallmedizinische Versorgung benötigten, versagte das System. Die Anwendung erkannte zudem zwar häufig gefährliche Befunde, beruhigte den fiktiven Patienten aber trotzdem. Vereinzelt führte es auch Menschen in vergleichsweise harmlosen Situationen zum Notruf.

„ChatGPT Health schnitt bei klassischen Notfällen wie Schlaganfall oder schweren allergischen Reaktionen gut ab“, ordnet Dr. Ramaswamy vom Mount Sinai Health System in New York in einer Mitteilung zur Studie ein. „Es hatte aber Schwierigkeiten in komplexeren Situationen, in denen die Gefahr nicht sofort ersichtlich war. Gerade dann ist das klinische Urteilsvermögen besonders wichtig. In einem Asthma-Szenario beispielsweise identifizierte das System in seiner Erklärung zwar frühe Warnzeichen für Atemversagen, riet aber dennoch zum Abwarten statt zu einer Notfallbehandlung.“

Das empfehlen die Forschenden Menschen, die KI-Tools für Gesundheitsfragen verwenden

Die Forschenden raten nicht gänzlich davon ab, KI-Anwendungen auch in medizinischen Fragen zu verwenden. Doch wenn sich Beschwerden verschlimmern oder Besorgnis erregen, ist eine Arztpraxis oder Klinik immer die bessere Adresse.

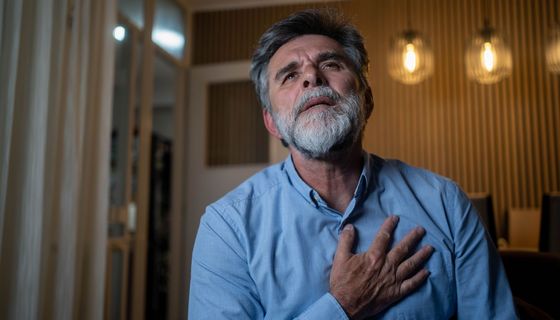

Insbesondere bei Symptomen wie Brustschmerzen, Atemnot, schweren allergischen Reaktionen oder schweren psychischen Problemen sollten Betroffene direkt ärztliche Hilfe suchen, anstatt sich auf die Anweisungen eines Chatbots zu verlassen.

Quelle: DOI 10.1038/s41591-026-04297-7

Medikamente ohne Zuzahlung

Alle zwei Wochen neu: die aktuelle Liste der zuzahlungsfreien Arzneimittel.

Arzneimitteldatenbank

Medikamenten-Name oder Wirkstoff eingeben für mehr Informationen.

Podcast

Im Fokus diesmal: Ein neues, hochwirksames Blutdruckmittel, die richtige Kaffeemenge für die Psyche…

Aktuelle Nachrichten

aus Apotheke, Forschung und Gesundheitspolitik.

Krankheiten von A - Z

In diesem Lexikon finden Sie umfassende Beschreibungen von etwa 400 Krankheitsbildern